Chapter 11: 나의 활동을 AI 외장 메모리로 — Obsidian × LLM 양방향 흐름

11.1 AI 시대의 연구란 무엇인가

포스트 #7 "Brain Augmentation" [Um, 2026]은 이렇게 시작한다: "AI 시대의 연구는 '내가 더 많이 아는 것'이 아니라 'AI scientist가 자가발전의 지식 창출을 이어갈 수 있는 환경을 구축하는 것'이다."

이것이 이 챕터의 출발점이다. 외장 메모리 시스템을 만드는 것은 편의 기능이 아니다. AI와 함께 연구하는 환경을 구축하는 것이다.

그 환경이 실제로 어떻게 생겼는지를 이 챕터에서 다룬다.

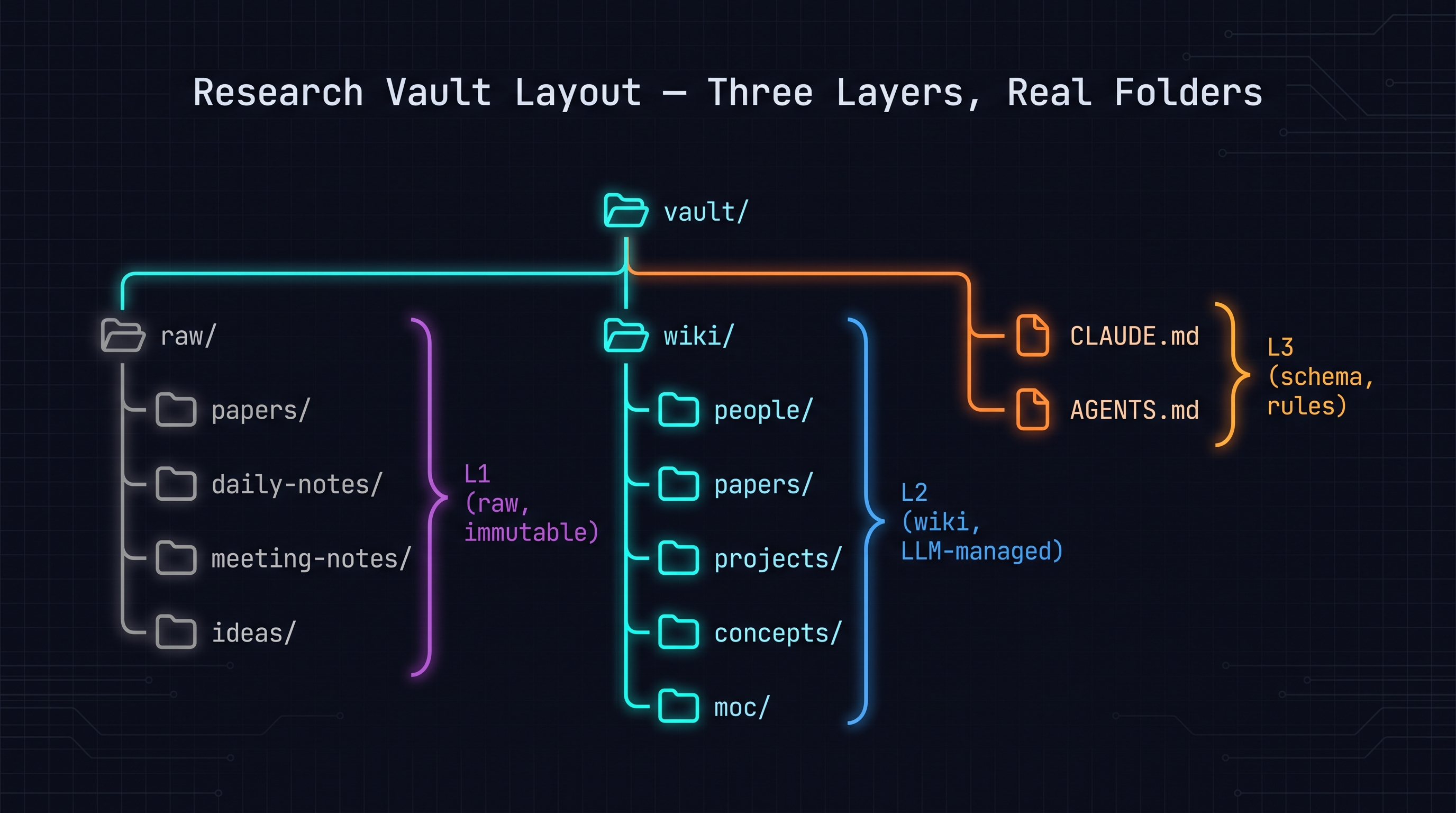

11.2 Vault 구조 — 실전

10장의 세 레이어를 실제 폴더 구조로 만들면:

vault/

├── raw/ # L1: 원본 자료

│ ├── papers/ # 논문 PDF, arXiv 링크

│ ├── daily-notes/ # 일일 메모

│ ├── meeting-notes/ # 미팅 기록

│ └── ideas/ # 아이디어 스크랩

│

├── wiki/ # L2: LLM이 관리하는 지식베이스

│ ├── people/ # 연구자, 동료

│ ├── papers/ # 논문 요약 + 메모

│ ├── projects/ # 프로젝트별 현황

│ ├── concepts/ # 기술 개념

│ └── moc/ # Map of Contents

│

├── CLAUDE.md # L3: Vault 구조 설명 (Claude용)

└── AGENTS.md # L3: Vault 구조 설명 (Codex용)

CLAUDE.md 예시 (L3):

# My Research Vault

This vault contains my research knowledge organized in three layers.

## Structure

- raw/papers/: Paper PDFs and arXiv links. READ ONLY.

- raw/daily-notes/: Daily notes from <TODAY_DATE>. READ ONLY.

- wiki/papers/: Paper summaries with my annotations. YOU CAN EDIT.

- wiki/concepts/: Technical concept pages. YOU CAN EDIT.

- wiki/moc/: Map of Contents pages. YOU CAN EDIT.

## Operations

When I say "ingest [paper]": read raw/papers/[paper], create/update wiki/papers/[paper].md

When I say "what do I know about [X]": search wiki/ for relevant pages and summarize.

When I ask a research question: search wiki/ AND raw/, synthesize an answer.

11.3 백링크와 태그 — LLM의 인덱스

Obsidian의 백링크([[링크]])와 태그(#태그)는 마크다운 파일 간 관계를 표현한다. LLM에게 이것은 인덱스다 [Okhlopkov, 2026].

백링크 활용법:

# Soft Robotic Hand Papers

Related: [[Gelsight Sensor]] [[Tactile Sensing]] [[Dexterous Manipulation]]

## Key Papers

- [[Tactile Sensing Survey]] — Tactile Sensing Overview...

- [[Dexterous Manipulation Paper]] — Dexterous Grasping with Force Feedback...

LLM이 "soft robotic hand와 관련된 논문 목록"을 요청받으면 [[Soft Robotic Hand Papers]] 페이지의 백링크를 따라 관련 페이지를 찾는다.

태그 활용법: 일관된 태그 시스템을 만들어두면 LLM이 필터링 기준으로 사용한다. 예: #reviewed, #keystone, #todo-summarize.

11.4 LLM에게 묻는 방법

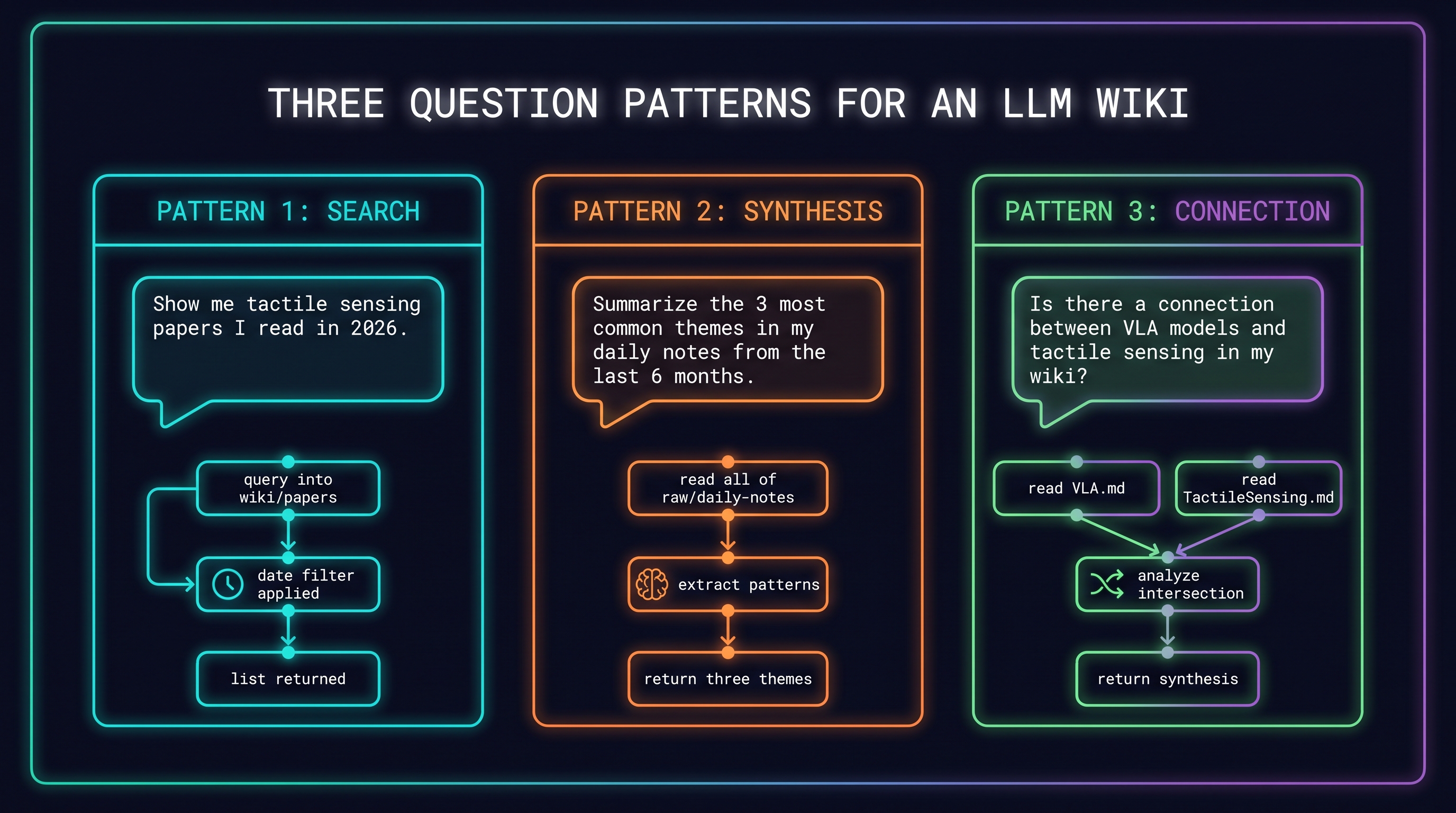

세 가지 질문 패턴이 효과적이다 [Karpathy, 2026]:

패턴 1: 검색형

"내가 2026년에 읽은 tactile sensing 논문 목록을 보여줘"

→ wiki/papers/ 검색, 날짜 필터 적용

패턴 2: 종합형

"최근 6개월의 daily notes에서 공통으로 나오는 주제를 3가지로 요약해줘"

→ raw/daily-notes/ 전체 읽고 패턴 추출

패턴 3: 연결형

"VLA(Vision-Language-Action model)와 tactile sensing이 연결되는 지점이 있어? wiki에서 찾아봐"

→ wiki/concepts/VLA.md + wiki/concepts/TactileSensing.md 읽고 교차점 분석

11.5 반론: 그래도 직접 써야 한다

포스트 [Um, 2026]는 외장 메모리 시스템의 역균형을 제시한다: "AI에게 모든 것을 위임하면, 생각이 외부화되는 것이 아니라 증발한다. 손으로 직접 쓰는 것은 이해의 확인이다 — LLM 요약을 읽는 것과 같지 않다."

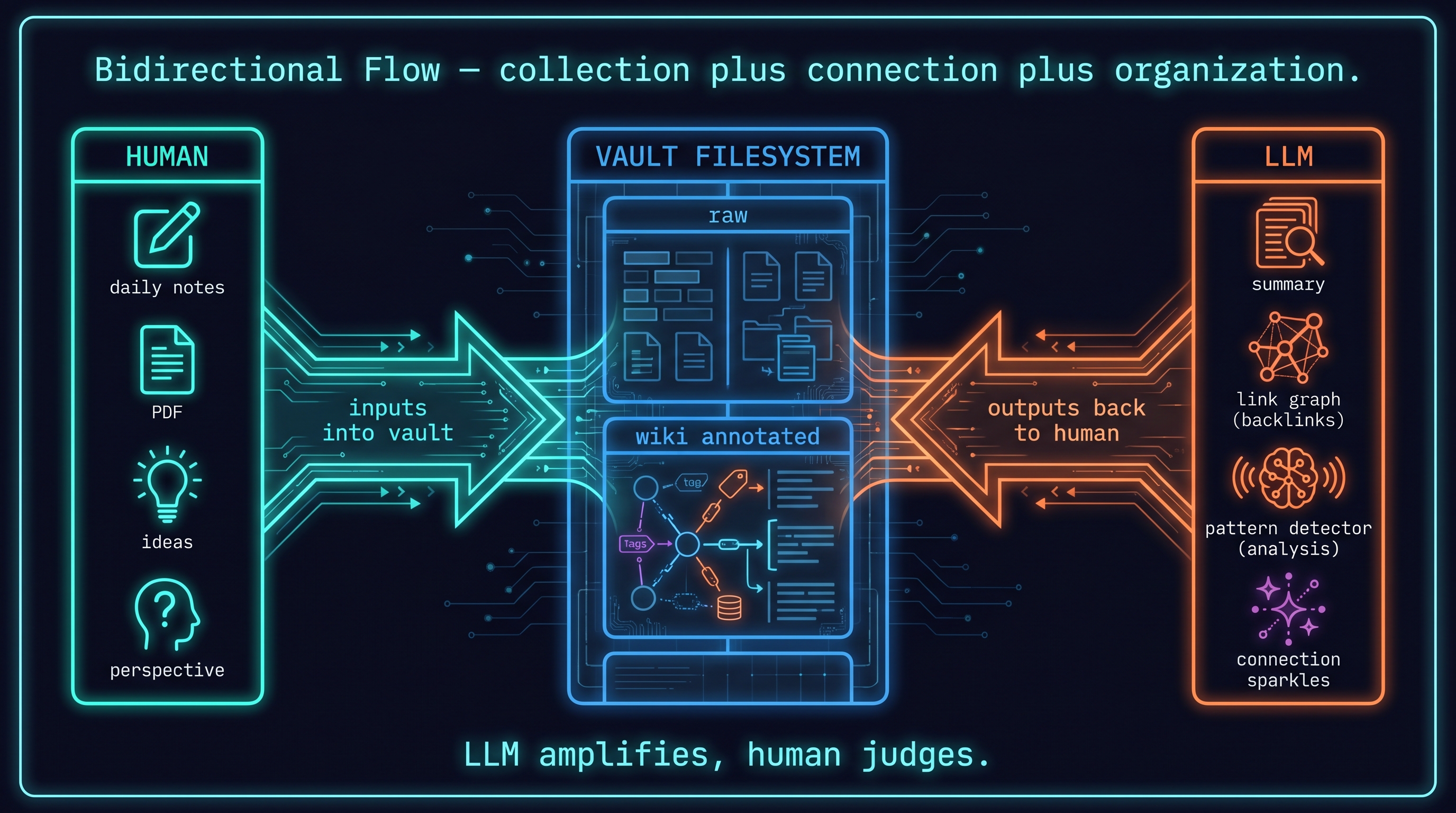

이것은 타당하다. 외장 메모리 시스템의 목표는 자신의 생각을 대체하는 것이 아니라 증폭하는 것이다. 균형을 찾는 방법:

- LLM은 수집, 연결, 정리를 한다

- 사람은 판단, 해석, 새로운 관점을 제공한다

- 일일 노트에 자신의 생각을 직접 쓰는 습관을 유지한다

[Maker, 2026]의 4개월 사용 보고: "LLM이 연결을 찾아주지만, 그 연결이 의미 있는지 판단하는 것은 여전히 나다."

11.6 양방향 흐름

외장 메모리 시스템의 핵심은 양방향 흐름이다:

사람 → LLM (입력):

- 일일 노트 작성 (

raw/daily-notes/) - 논문 PDF 추가 (

raw/papers/) - 아이디어 스크랩 (

raw/ideas/) - 질문할 때 자신의 관점을 명시 ("내 연구 방향은 X이고, 이 맥락에서 Y에 대해 알고 싶다")

LLM → 사람 (출력):

- 요약과 종합 (

wiki/papers/업데이트) - 관련 논문 발견 (백링크 탐색)

- 패턴 식별 (daily notes 분석)

- 새로운 연결 제안

[Um, 2026]가 제시하는 프레임: "AI는 레버리지다. 레버리지는 나의 역량을 증폭하지만, 기반이 없으면 아무것도 증폭하지 못한다."

포스트 #7의 결론 [Um, 2026]: "이 공간은 단순한 홈페이지가 아니다. AI와 내가 함께 생각하는 공간이다. 그리고 더 나아가, AI scientist가 스스로 지식을 생성할 수 있는 연구 환경이다."

참고문헌

- terryum, "Brain Augmentation," post #7, 2026-03-10. [Um, 2026]

- terryum, "새로운 레버리지," terryum-ai, 2026. [Um, 2026]

- terryum, "직접 쓰는 것의 가치," terryum-ai, 2026. [Um, 2026]

- Karpathy, Andrej, "LLM Wiki," gist, 2026. [Karpathy, 2026]

- Aimaker, "AI-powered second brain — 4-month report," 2026. [Maker, 2026]

- Starmorph, "LLM Wiki guide," 2026. [Starmorph, 2026]

- Okhlopkov, "Claude Code 4-month setup retrospective," 2026. [Okhlopkov, 2026]

- Bsukistory, "AI 자동화 관점 (Korean)," 2026. [Brunch, 2026]

- Anthropic, "Claude memory documentation," 2026. [Anthropic, 2026]