Chapter 10: LLM Wiki의 등장 — Karpathy의 Obsidian + Claude Code 워크플로우

10.1 16백만 뷰짜리 gist

2026년 초, Andrej Karpathy가 gist 하나를 공개했다 [Karpathy, 2026]. 제목: "LLM Wiki." 내용은 간단했다: Obsidian vault를 세 레이어로 구성하고, Claude Code로 지식을 인덱싱하고, 질문에 답하게 한다. 이것을 소개하는 트윗 [Karpathy, 2026]이 16M+ 뷰를 기록했다 [Karpathy, 2026].

왜 그렇게 폭발적 반응이었는가? 패턴이 단순하면서 강력했기 때문이다. "내 모든 것을 마크다운으로 만들고, LLM에게 그것을 읽히고, 질문에 답하게 한다." 이것이 전부다. 하지만 이 단순한 패턴이 일회성 채팅 도구를 복리로 쌓이는 개인 지식 엔진으로 전환하는 것이다 [host), 2026].

10.2 세 레이어

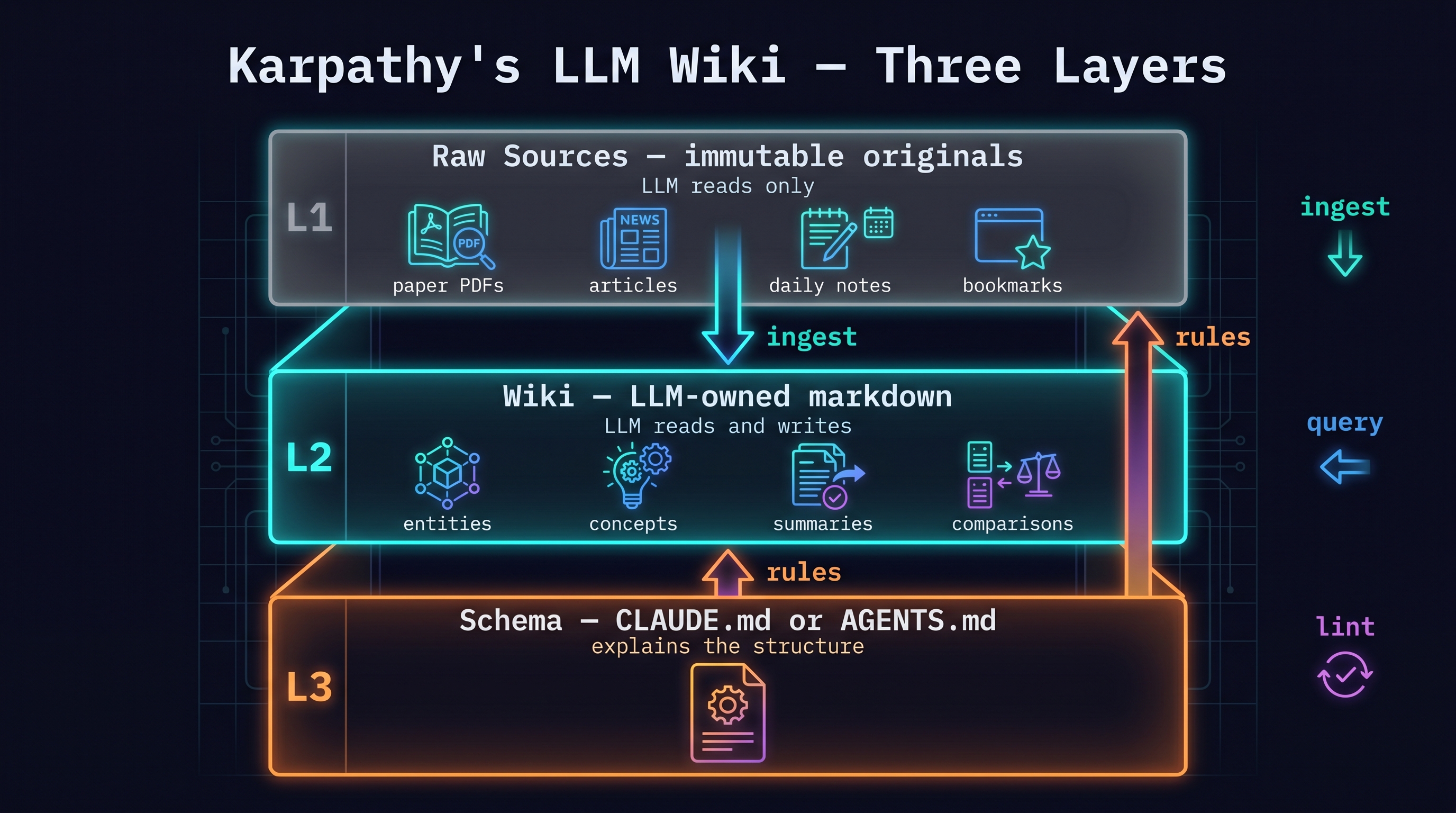

Karpathy의 LLM Wiki는 세 레이어로 구성된다 [Karpathy, 2026]:

L1: Raw Sources — 불변 원본

vault/

└── raw/

├── papers/ # PDF, arXiv, 논문

├── articles/ # 블로그, 뉴스

├── notes/ # 회의 메모, 아이디어

└── bookmarks/ # 북마크, 스크랩

LLM은 이 레이어를 읽기만 한다. 쓰지 않는다. 원본 불변성이 보장된다.

L2: Wiki — LLM이 소유하는 마크다운

vault/

└── wiki/

├── entities/ # 사람, 프로젝트, 회사

├── concepts/ # 기술 개념, 용어

├── summaries/ # 논문·글 요약

└── comparisons/ # 비교·대조 페이지

LLM이 L1을 읽고 이 레이어를 작성하고 업데이트한다. 엔티티 페이지, 개념 페이지, 비교 페이지 등.

L3: Schema — CLAUDE.md 또는 AGENTS.md

LLM에게 이 vault 구조를 설명하는 파일. "wiki/entities/에 사람 페이지가 있다", "wiki/concepts/에 기술 용어 페이지가 있다" 등을 알려준다.

세 가지 기본 연산:

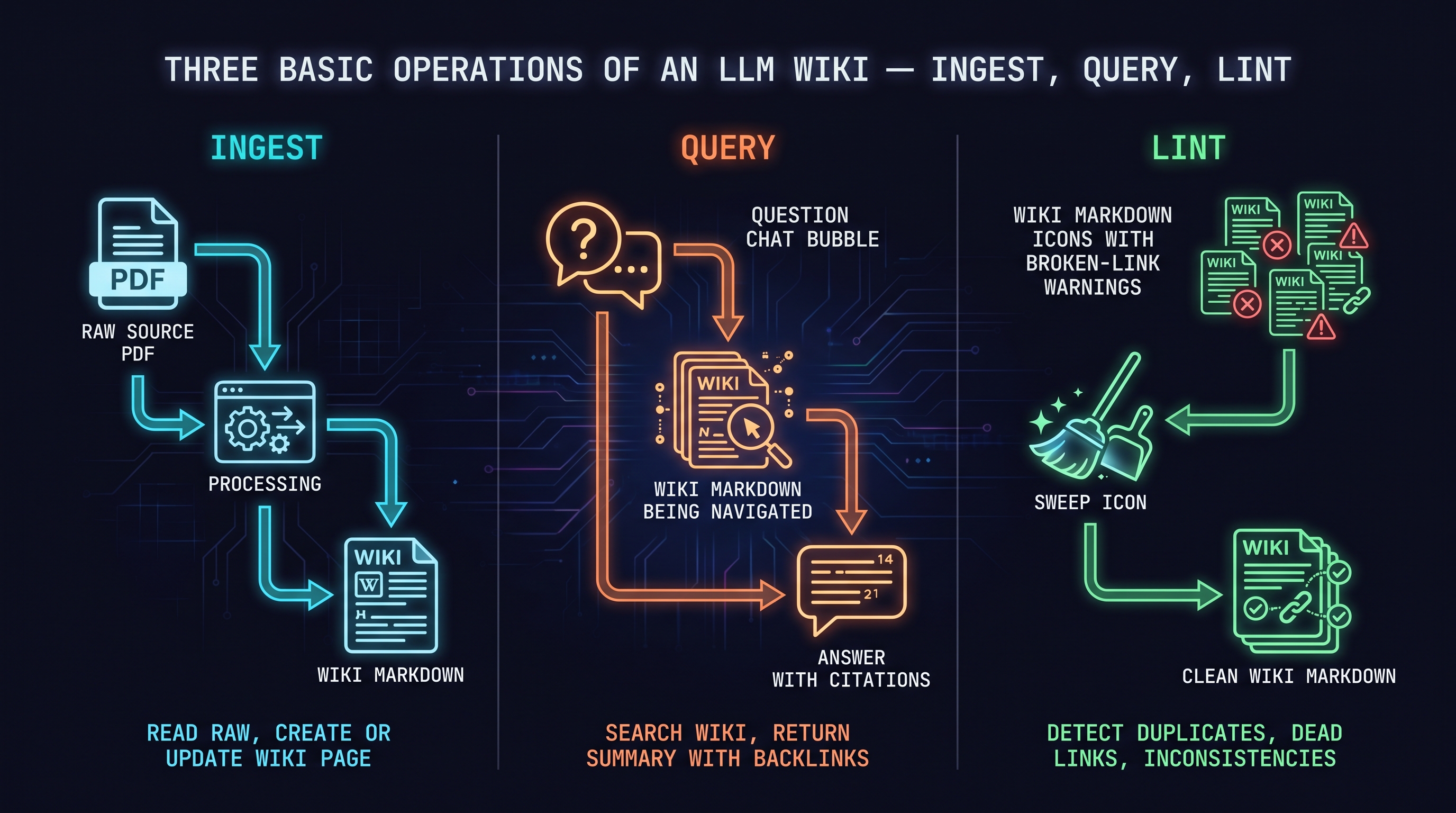

- ingest: raw source를 추가하고 wiki 페이지를 생성/업데이트

- query: 질문에 답하기 위해 wiki를 탐색

- lint: wiki 내 깨진 링크, 중복, 불일치 정리

10.3 패턴이 커뮤니티를 흡수하다

Karpathy의 gist 공개 이후 커뮤니티 반응이 빠르게 형성됐다:

- [Joshi, 2026]: "How I built my personal LLM Wiki in a weekend"

- [Paige, 2026]: Obsidian second brain + Claude Code 통합

- [Maker, 2026]: "How I took Karpathy's LLM Wiki and built an AI-powered second brain"

- [Starmorph, 2026]: 단계별 설치 가이드

- [MindStudio, 2026]: Mind Studio 구현 사례

Nate Herk의 영상 "Karpathy 10x'ed Claude Code" [Herk, 2026]의 프레이밍이 이 확산을 가장 잘 설명한다: "LLM Wiki is a 10x tool — it converts a one-shot chat tool into a compounding personal knowledge engine." (YouTube ID: 20d5cSkSvcU, 2026-04-05 Nate Herk 업로드; fact-checker가 원본 업로드임을 확인)

10.4 반론: 지식 그래프가 필요하다

커뮤니티가 LLM Wiki를 채택하면서 한계도 드러났다. infranodusllmwiki2026의 비판:

"Karpathy의 LLM Wiki는 flat-file 구조다. 엔티티 간 관계를 표현하지 못한다. 'A는 B를 cited했다', 'C는 D의 후속이다' 같은 관계적 지식은 마크다운 파일로 표현하기 어렵다. Knowledge graph 레이어가 필요하다."

이 비판은 타당하다. 다만 Karpathy의 패턴이 "완벽한 지식 관리 시스템"이 아니라 LLM과 함께 작동하는 좋은 시작점이라는 맥락에서 이해해야 한다. 복잡한 관계적 지식이 필요한 use case라면 knowledge graph 레이어 추가를 고려할 수 있다.

10.5 "Farzapedia" — 개인화의 극단

Karpathy가 소개한 개념 [Karpathy, 2026]: "당신만의 위키피디아". 당신의 관심사, 당신이 읽은 논문, 당신이 참여한 프로젝트 — 모두 당신 관점에서 정의된 위키. 전 세계가 같은 위키피디아를 쓰는 것과 달리, 각자가 자기 맥락에서 최적화된 지식 베이스를 갖는다.

이것이 11장의 주제다: 이 패턴을 자신의 활동과 연결한다.

10.6 Claude Code vs Codex: 어느 것으로 LLM Wiki를 운영하는가

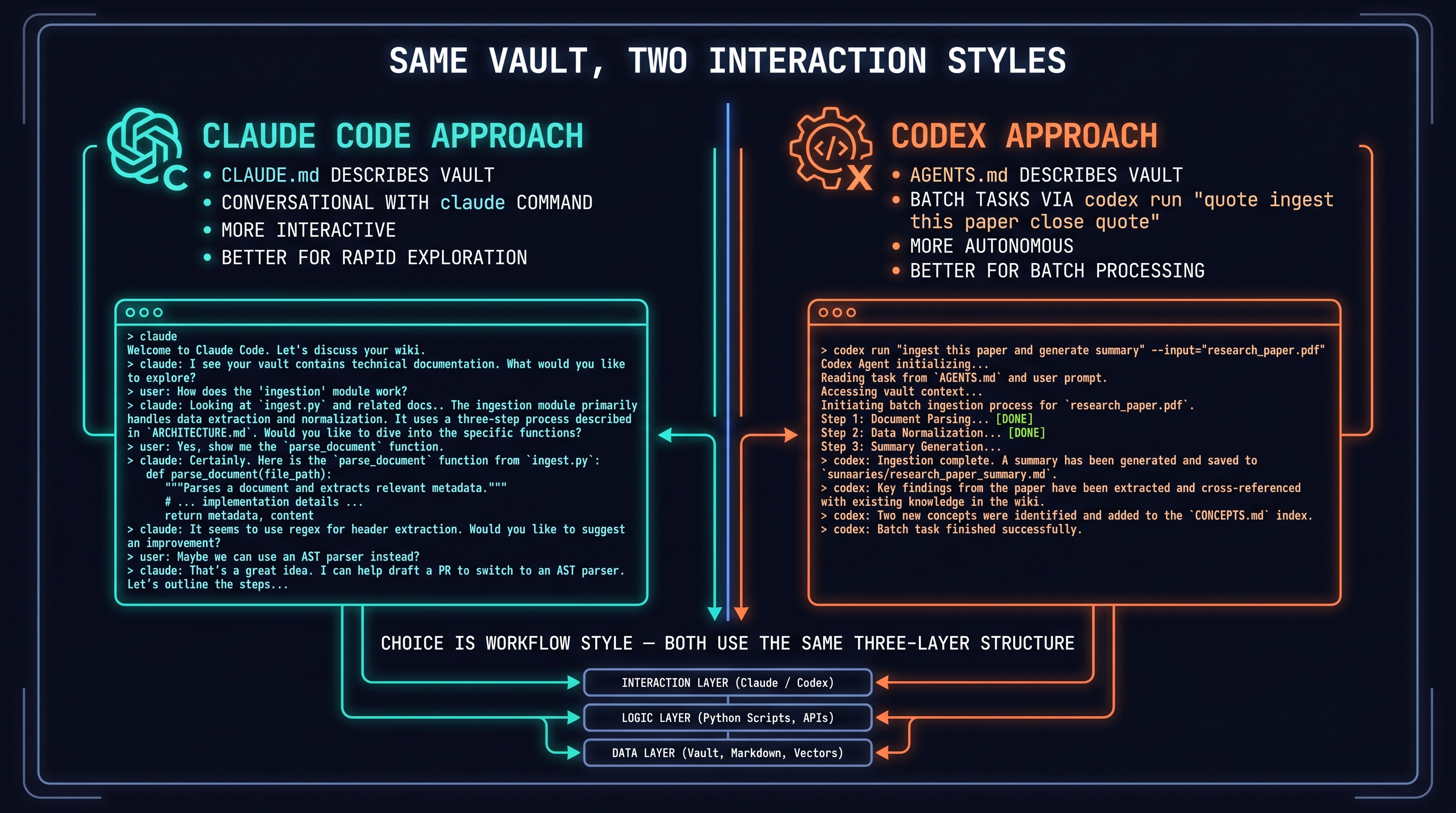

Karpathy의 원래 구현은 Claude Code + Obsidian 조합이었다. Codex로도 똑같이 작동한다:

Claude Code 방식: CLAUDE.md에 vault 구조를 설명하고, claude로 대화하면서 wiki를 업데이트한다. 더 대화형이고 빠른 실험에 적합하다.

Codex 방식: AGENTS.md에 vault 구조를 설명하고, codex exec "ingest this paper" 형식으로 태스크를 실행한다. 더 자율적이고 배치 처리에 적합하다.

두 방식 모두 동일한 세 레이어 구조를 사용한다. 선택은 작업 스타일의 문제다.

참고문헌

- Karpathy, Andrej, "LLM Wiki," gist, 2026. [Karpathy, 2026]

- Karpathy, Andrej, "LLM Wiki tweet," Twitter, 2026. [Karpathy, 2026]

- Karpathy, Andrej, "LLM Wiki talk / post," 2026. [Karpathy, 2026]

- Karpathy, Andrej, "Farzapedia — personalization argument," 2026. [Karpathy, 2026]

- Joshi, "How I built my personal LLM Wiki," Medium, 2026. [Joshi, 2026]

- Paige, "Second brain setup," 2026. [Paige, 2026]

- Aimaker, "AI-powered second brain from LLM Wiki," 2026. [Maker, 2026]

- Starmorph, "LLM Wiki step-by-step guide," 2026. [Starmorph, 2026]

- Mindstudio, "Karpathy Wiki implementation," 2026. [MindStudio, 2026]

- Herk, Nate, "Karpathy 10x'ed Claude Code," YouTube (ID: 20d5cSkSvcU), 2026-04-05. [Herk, 2026]

- Infranodus, "LLM Wiki needs a knowledge graph," 2026. [infranodusllmwiki2026]

- LLM Wiki Full Setup, "Canonical demo," 2026. [llmwikifullsetup2026]