Chapter 12: 분야별 AI Scientist 실전 — AI/로봇, 바이오/화학/신약, autoresearch

12.1 한 주 안에 두 개의 존재 증명

2026년 4월, 같은 주에 두 논문이 나왔다.

Anthropic의 AAR (자율 정렬 연구) [Anthropic, 2026]: Claude Opus 4.6 인스턴스 9개가 5일간 정렬 연구를 자율적으로 수행했다. 결과: PGR(Progress Rate) 0.97 vs 인간 기준선 0.23. 비용: 시간당 약 $22. 9개 에이전트가 독립적으로 연구하고, 결과를 통합하고, 새 가설을 생성했다.

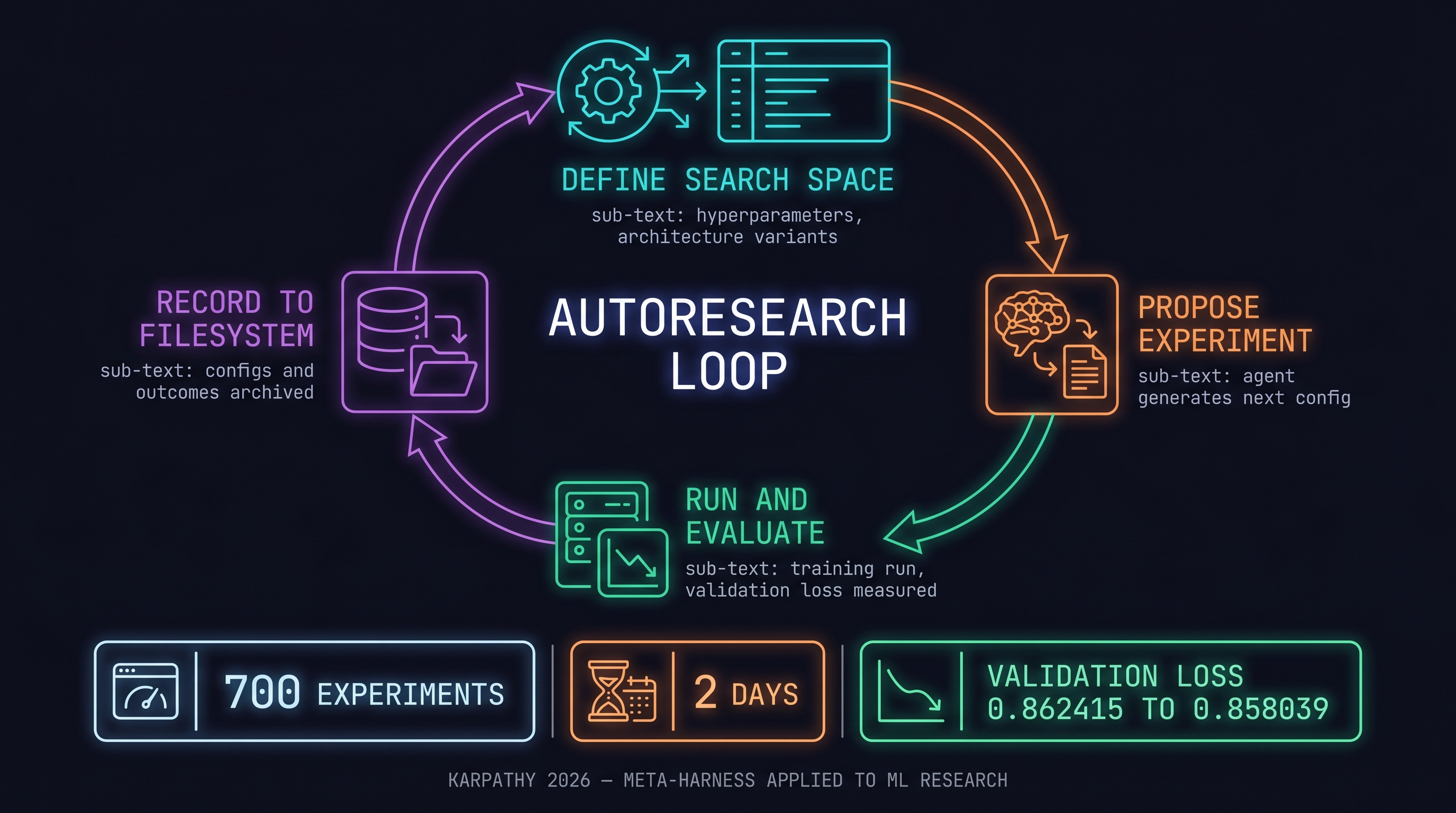

Karpathy의 autoresearch [Karpathy, 2026]: GPT-2 학습 최적화에 700회 실험을 2일 만에 수행했다. Validation loss 0.862415 → 0.858039 (-0.4%). 인간이 수개월 걸릴 탐색을 에이전트가 이틀에 마쳤다.

한 주 만에 정렬 연구(Anthropic)와 ML 연구(Karpathy) 양쪽에서 자율 에이전트가 프로덕션급 결과를 냈다. 이것이 AI Scientist가 "미래 이야기"가 아니라 "지금 일어나는 일"임을 보여주는 증거다.

12.2 연구 민주화의 세 단계

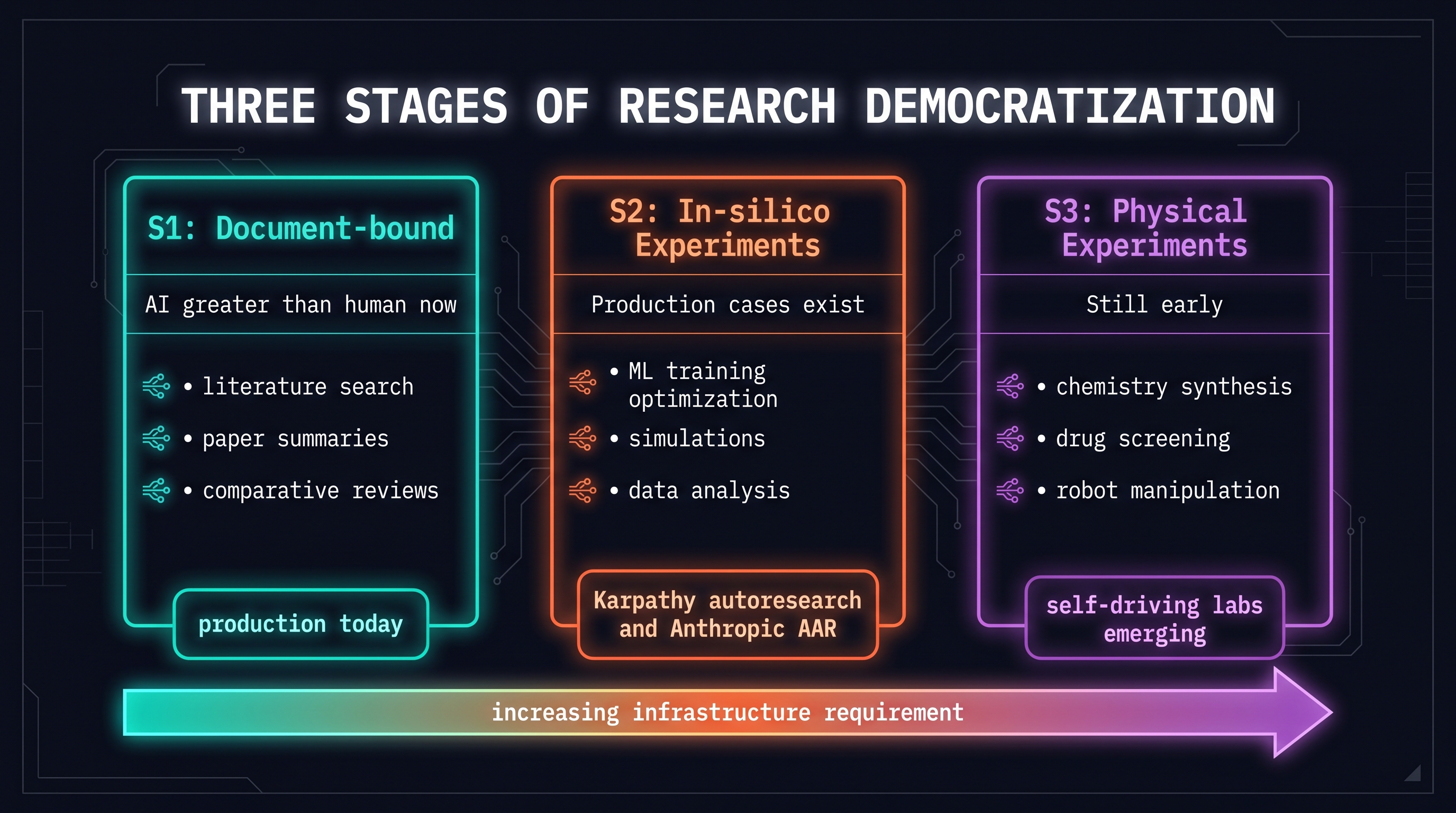

포스트 [Um, 2026]은 AI 기반 연구를 세 단계로 분류한다:

S1: 문서 기반 연구 (Document-bound)

이미 AI > 인간인 단계. 문헌 검색, 논문 요약, 비교 분석, 리뷰 작성. Claude Code + LLM Wiki로 지금 당장 할 수 있다.

S2: 인실리코 실험 (In-silico)

컴퓨터 안에서 완결되는 실험. ML 학습, 시뮬레이션, 데이터 분석. Karpathy의 autoresearch와 Anthropic의 AAR이 이 단계의 프로덕션 사례다.

S3: 물리 실험 (Physical)

실제 실험실, 실제 화학물질, 실제 로봇이 필요한 실험. 아직 초기 단계지만 방향은 명확하다.

12.3 ML / 정렬 연구 — 자율 에이전트

Karpathy의 Autoresearch

[Karpathy, 2026]의 설계 [Karpathy, 2026]:

- 탐색 공간 정의: GPT-2 학습 하이퍼파라미터 조합 (learning rate, batch size, architecture 변형 등)

- 에이전트 루프: 제안 → 실행 → 평가 → 다음 제안

- 결과 기록: 모든 실험의 설정과 결과를 파일시스템에 저장

- Meta-Harness 패턴: 9장의 메타하네스가 이 루프 자체다

[Karpathy, 2026]은 nanochat(작은 GPT-4 모델)을 같은 방식으로 1일 안에 학습시켰다. 패턴의 확장성을 보여주는 사례다.

Anthropic의 AAR

[Anthropic, 2026]의 핵심 발견: 에이전트 9인이 독립적으로 연구하는 것이 단일 에이전트의 장기 실행보다 효과적이었다. "다양성이 수렴 방지"였다. PGR 0.97은 같은 태스크에 인간 전문가가 달성한 0.23의 4배가 넘는다.

이 두 사례가 공통으로 시사하는 것: 에이전트 루프 + 파일시스템 기반 경험 축적 + 메타하네스 패턴이 연구 자동화의 핵심 구조다.

12.4 의료 AI — 임상 태스크 벤치마크

Wu et al. 2026 (arXiv 2603.28589) [Um, 2026]의 Med-AI Bench:

- 19개 임상 태스크

- 171개 사례

- 범위: 진단, 치료 계획, 의료 보고서 생성, 임상 추론

결과: AI가 여러 임상 태스크에서 인간 기준선 이상을 달성했다. 특히 문서화 집약적 태스크(보고서 생성, 코딩)에서 격차가 컸다.

주의: 이 벤치마크는 AI의 임상 사용 가능성을 보여주지만, 실제 임상 배포는 규제·윤리·검증의 별도 프로세스가 필요하다. AI Scientist가 임상 연구를 지원할 수 있지만, 임상 판단을 대체하는 것과는 다른 문제다.

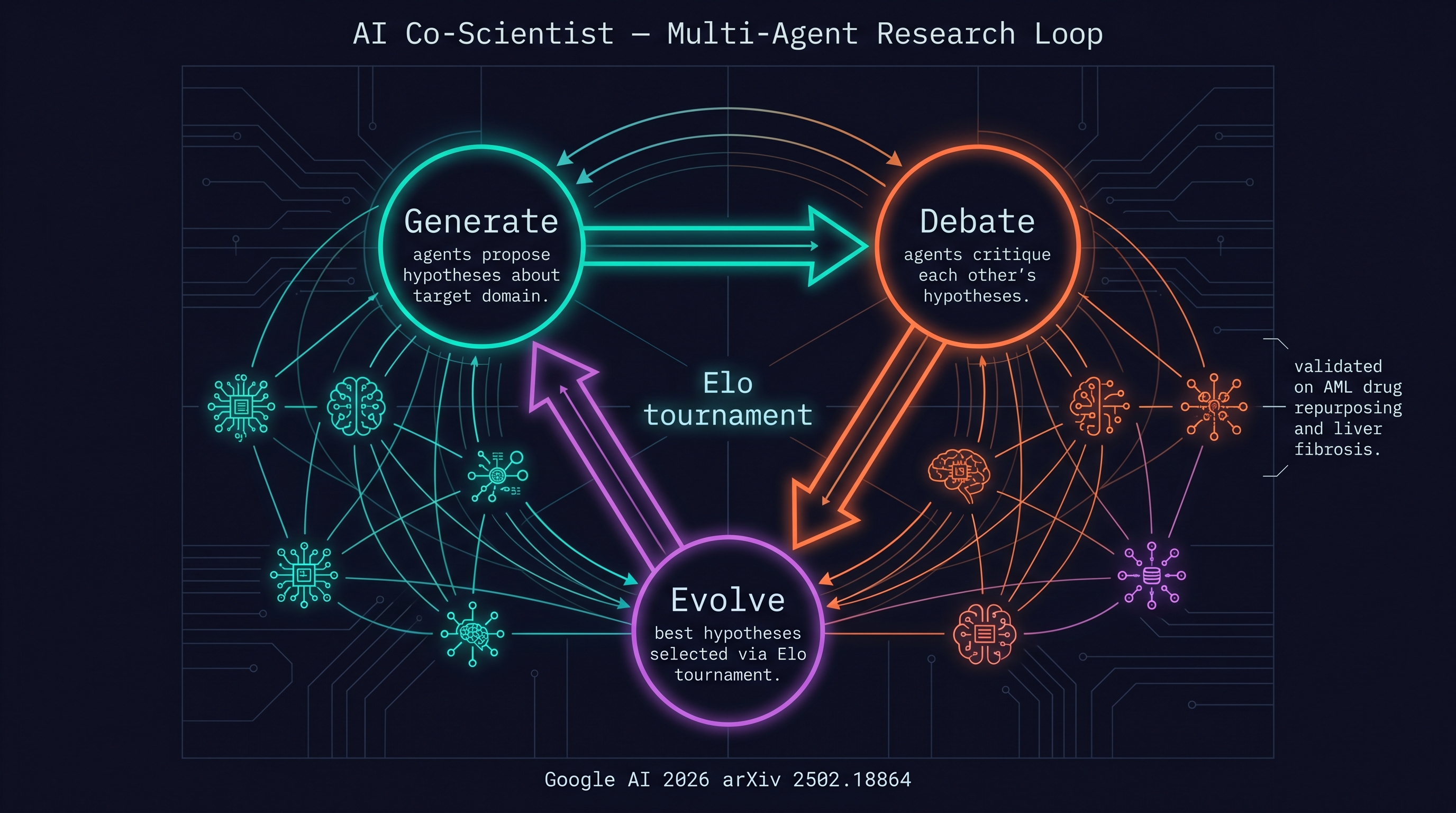

12.5 AI Co-scientist — 구글의 멀티에이전트 연구 시스템

구글의 AI Co-scientist (arXiv 2502.18864) [Um, 2026]:

- 아키텍처: Gemini 2.0 기반 멀티에이전트 시스템

- 루프: Generate → Debate → Evolve + Elo 토너먼트

- 검증 도메인: AML(급성 골수성 백혈병) 약물 재목적화, 간 섬유화

핵심 혁신: 에이전트들이 서로의 가설을 토론하고 비판한다. Elo 토너먼트로 가장 강한 가설을 자동 선별. 인간 전문가 피드백 없이 새로운 가설을 생성하고 검증한다.

이것은 9장의 의존성 그래프 + 멀티에이전트 검증 + 메타하네스를 연구 도메인에 적용한 것이다.

12.6 자가 구동 실험실 — 화학/바이오

- 화학 합성과 스크리닝을 자율 수행하는 실험실

- 인간이 실험을 설계하면, 로봇이 실행하고, AI가 결과를 분석하고, 다음 실험을 제안한다

- 현재: 소재 발견, 약물 후보 탐색에 적용 중

이 단계는 연구 민주화의 S3 단계다. S1(문서)과 S2(인실리코)는 지금 당장 가능하지만, S3는 물리적 인프라와 안전 검증이 추가로 필요하다.

12.7 범위의 정직성 — 로봇공학 분야

이 챕터의 제목에 "AI/로봇"이 포함되어 있지만, 현재 코퍼스에는 로봇공학 특화 AI Scientist 사례가 충분히 없다. 따라서 다음 사항을 명확히 한다:

- 포함된 것: ML/정렬 연구(autoresearch, AAR), 의료 AI(Med-AI Bench), 화학/바이오(자가 구동 실험실), AI Co-scientist(구글)

- 제외된 것: 로봇공학 특화 AI Scientist — 이 분야는 현재 준비 중이다 (Part V: Robotics는 forthcoming)

로봇공학 분야의 AI Scientist는 물리적 실험 루프가 훨씬 복잡하다. 시뮬레이션에서는 S2가 가능하지만, 실제 하드웨어 실험은 별도의 안전 검증 체계가 필요하다. 이 책이 솔직하게 말할 수 있는 것은 여기까지다.

12.8 책의 루프를 닫으며

1장에서 "지식의 외부화"로 시작했다. Claude→Codex 전환의 진짜 비용은 코드 변경이 아니라, 모델 내부에 갇혀 있던 지식을 AGENTS.md·HANDOFF.md·TASKS.md 같은 평문 파일로 꺼내는 것이다.

10장의 LLM Wiki는 그 외부화를 연구 지식으로 확장했다. 11장은 일상 활동을 AI 외장 메모리로 만들었다. 그리고 이 12장은 그 외장 메모리가 연구 루프 자체가 되는 지점을 보여준다.

Karpathy의 궤적이 이것을 가장 잘 보여준다:

- LLM Wiki (10장): "내 모든 것을 마크다운으로"

- Autoresearch (12장): "에이전트가 실험을 수행"

- 같은 저자, 같은 scaffolding, 1년 간격

외장 메모리에서 시작해 자율 연구까지 — 하네스 엔지니어링의 최종 목적지다.

참고문헌

- Anthropic, "Autonomous Alignment Research (AAR)," 2026-04-14. [Anthropic, 2026]

- Karpathy, Andrej, "Autoresearch," 2026. [Karpathy, 2026]

- Karpathy, Andrej, "Autoresearch — Round 1 tweet," 2026. [Karpathy, 2026]

- Karpathy, Andrej, "NanoChat," 2026. [Karpathy, 2026]

- terryum, "AAR post," terryum-ai, 2026. [Um, 2026]

- terryum, "Autoresearch post," terryum-ai, 2026. [Um, 2026]

- terryum, "AI Co-scientist post," terryum-ai, 2026. [Um, 2026]

- Wu et al., "Med-AI Bench," arXiv 2603.28589, 2026. [Um, 2026]

- terryum, "Self-driving labs post," terryum-ai, 2026. [Um, 2026]

- terryum, "Research democratization post," terryum-ai, 2026. [Um, 2026]

- Google AI, "AI Co-scientist," arXiv 2502.18864, 2026. (primary source for [Um, 2026])