Chapter 8: GPT-5.5 출시 후 — 커뮤니티가 발견한 패턴

8.1 하나의 호: 4월 16일 → 4월 23일 → 첫 한 달

7장은 4월 23일 GPT-5.5의 Codex 착지로 끝났다. 하지만 커뮤니티가 왜 그렇게 반응했는지 이해하려면 4월 23일이 아니라 4월 16일에서 시작해야 한다.

Opus 4.7이 4월 16일에 "fewer subagents by default" 변경과 함께 출시됐을 때, 단순한 기능 변경이 아니었다 — 모호성 세금을 만들어냈다. 7일 동안 4.6에서 작동하던 프롬프트가 이제 명시적 지시를 요구한다는 것을 발견한 개발자들이 r/ClaudeAI, HN, X에 불만을 쌓아갔다 [MerchMind AI, 2026; Xlork Blog, 2026].

그 7일 후, 4월 23일에 GPT-5.5가 Codex에 탑재되어 등장했다. Reddit 500개 이상의 댓글 종합 [contributor, 2026]이 내놓은 핵심 문장: "Claude Code는 품질이 더 높지만 쓸 수가 없다. Codex는 품질이 약간 낮지만 실제로 쓸 수 있다."

"쓸 수가 없다"는 말은 4월 23일에 생겨난 게 아니다. 4월 16일에 씨앗이 뿌려진 것이다.

이미 2025년 9월부터, Codex 채택 가속기가 시작될 때 Sam Altman은 같은 우려를 표한 바 있다 [News, 2025]: "Codex에 유리한 Reddit 분위기가 매우 가짜처럼 느껴진다."

두 관측이 동시에 맞을 수 있다. 모호성 세금 불만은 진짜이고 유기적이었다; Codex 열광의 일부는 증폭됐을 수 있다. 이 챕터는 두 관점을 모두 열어두고, 독립적으로 검증된 실용적 패턴에 집중한다 — Reddit 투표가 아니라.

소스 사용에 대한 메모. 이 챕터는 2026년 4~5월의 Reddit 쓰레드, HN 토론, X 포스트를 인용한다. 이 소스들은 눈을 뜨고 사용한다. Sam Altman은 2025년 9월 Codex에 유리한 Reddit sentiment가 "매우 가짜처럼 느껴진다"고 표한 바 있으며 [Altman, 2025], 그 우려는 GPT-5.5 출시와 함께 사라지지 않았다. 코퍼스에 조직적으로 증폭된 목소리가 섞여 있을 수 있다. 아래의 레시피는 각각 독립적 실험이나 여러 소스의 수렴으로 뒷받침되며, Reddit 투표 수만으로는 포함하지 않았다. 커뮤니티 sentiment에만 의존하는 소스는 그렇게 표시한다.

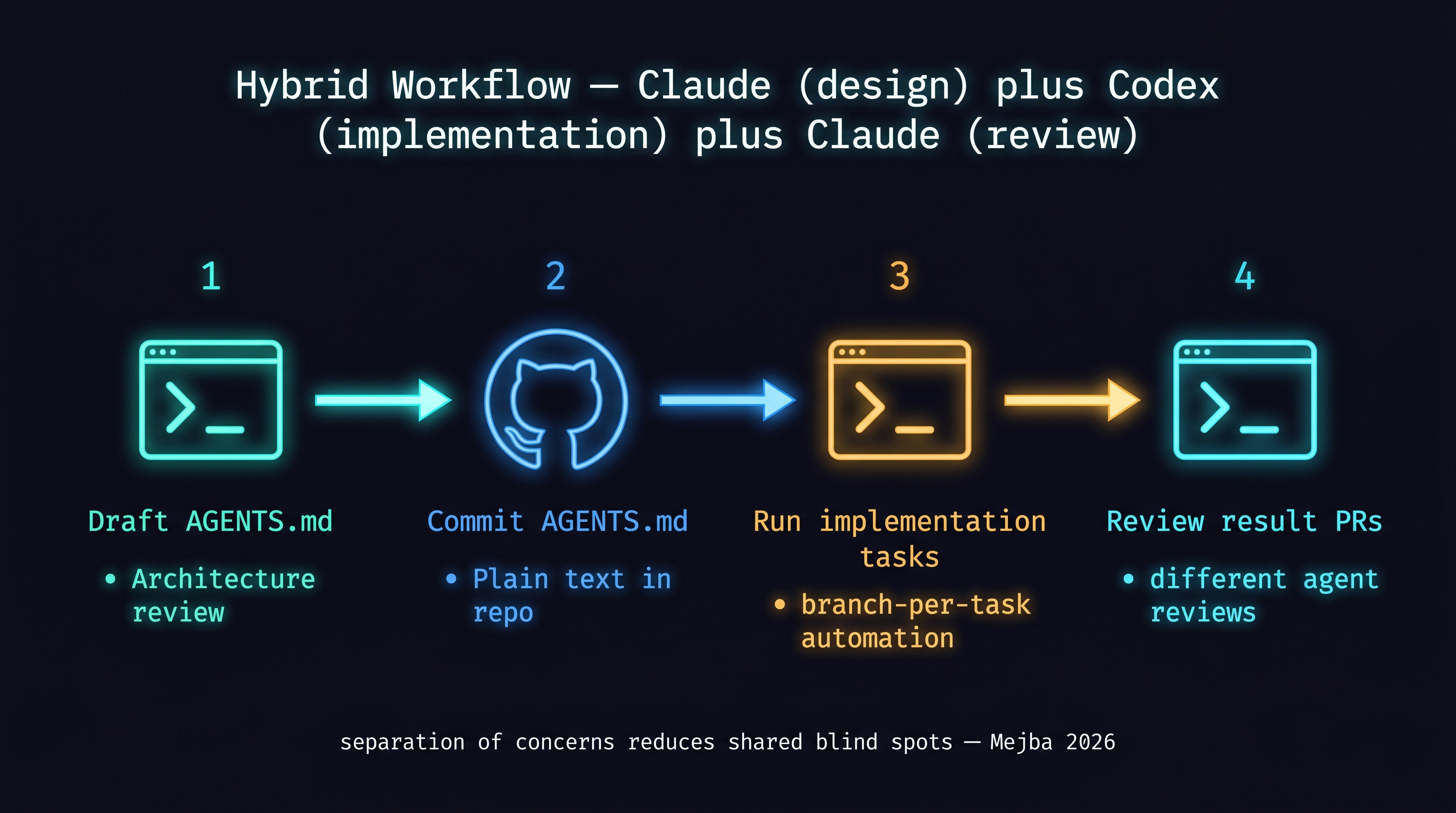

8.2 레시피 1: 하이브리드 사용 — Claude(설계·하네스) + Codex(구현·검증)

가장 많이 보인 패턴은 "갈아타기"가 아니라 역할 분담이다.

- Claude Code: 설계, 하네스 작성(CLAUDE.md / AGENTS.md 초안), 아키텍처 리뷰

- Codex: 구현, 리팩터링, 테스트 생성, 자율 장기 태스크

Mejba Ahmed의 실험 [Ahmed, 2026]이 이 패턴의 극단적 버전이다: Codex를 Claude Code의 서브에이전트로 실행. Addy Osmani의 "Code Orchestra" [Osmani, 2026]는 멀티모델 라우팅으로 확장한다 — 계획에는 cheap 모델, 구현에는 frontier, 보안 리뷰에는 전용 모델.

실제 적용:

- Claude Code에서

AGENTS.md초안을 작성한다 AGENTS.md를 저장소에 커밋한다- Codex로 구현 태스크를 실행한다

- 결과 PR을 Claude Code에서 리뷰한다

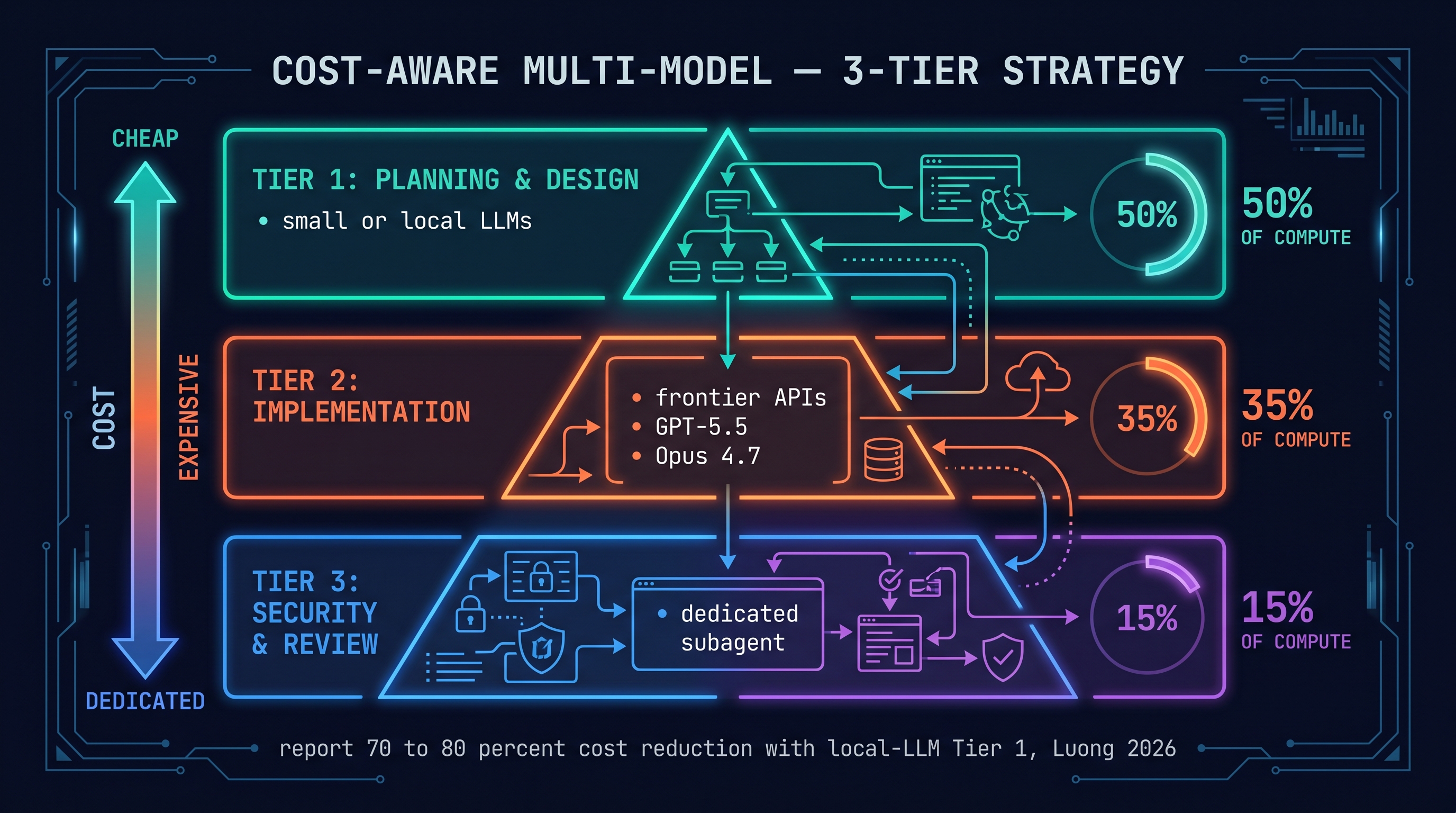

8.3 레시피 2: 비용 인식 멀티모델

모든 작업에 frontier 모델을 쓰는 것은 낭비다. 커뮤니티가 수렴한 3-tier 전략:

Tier 1 (계획, 설계): cheaper/faster 모델 또는 lower effort

Tier 2 (구현): frontier 모델 (GPT-5.5, Opus 4.7)

Tier 3 (보안, 리뷰): 전용 작업 지시가 있는 서브에이전트

Luong의 "Local LLMs with Frontier" 가이드 [NGUYEN, 2026]는 더 급진적 버전: Tier 1에 local LLM(llama, deepseek-coder)을 쓰고, Tier 2에만 API를 쓴다. 비용을 70-80% 줄일 수 있다는 보고다.

Osmani의 접근 [Osmani, 2026]: 같은 태스크에 3개 모델을 라우팅하고 결과의 신뢰도가 높을 때만 merge한다.

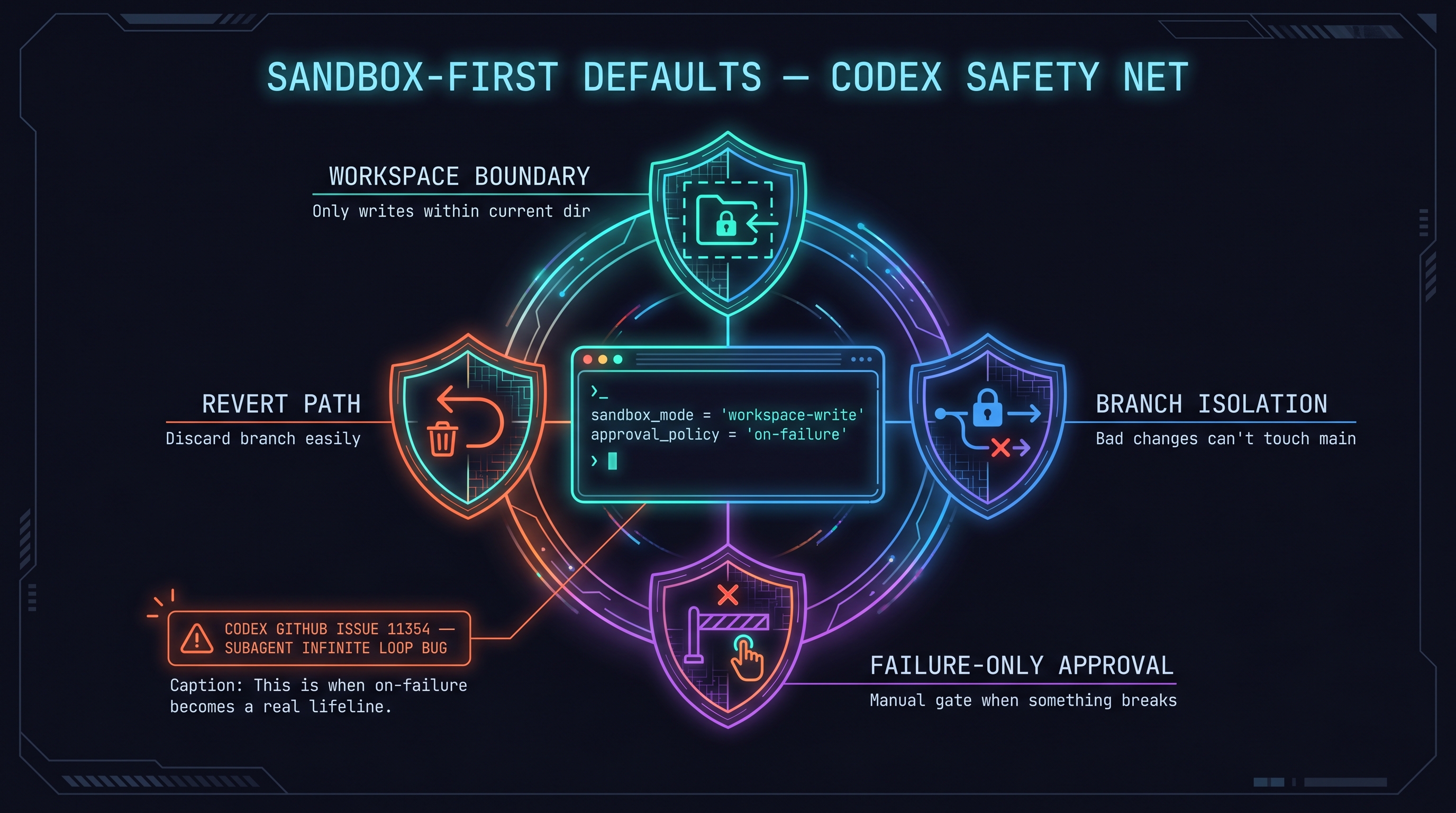

8.4 레시피 3: Sandbox-first 기본값

GPT-5.5 출시 후 한 달간 가장 많이 공유된 설정 [Proser, 2026]:

sandbox_mode = "workspace-write"

approval_policy = "on-request"

Branch-per-task가 기본 안전망이다. 각 태스크가 독립 브랜치에서 실행되므로, 잘못된 변경은 main을 건드리지 않는다.

실패 사례: Codex GitHub issue #11354 [contributors, 2026]. 서브에이전트가 실행 중 특정 조건에서 무한 루프에 빠지는 버그. 이 버그의 존재는 두 가지를 말해준다: (1) Codex의 서브에이전트 시스템은 아직 초기 단계이고, (2) approval_policy = "on-request" 설정이 이런 케이스에서 구명줄이 된다.

8.5 레시피 4: 자신의 벤치마크를 믿지 마라

MorphLLM의 결과 [MorphLLM, 2026]:

- Terminal-Bench: Codex 77.3 > Claude Code 65.4

- 블라인드 리뷰 선호도: Claude Code 67% > Codex 25%

벤치마크에서 이긴 도구가 실제 사람이 선호하는 출력을 내지 않는다. 자신의 작업에서 직접 측정하지 않은 벤치마크는 참고만 한다.

실용적 방법: 자신이 실제로 하는 태스크 3-5개를 선정하고, 두 도구로 실행한 결과를 직접 비교한다. 자신의 맥락에서의 선호가 어떤 벤치마크보다 더 정확한 지표다.

8.6 Codex Desktop과 Computer Use

[Science, 2026]이 소개한 Codex Desktop:

- Computer Use 통합

- 90+ 플러그인

- 터미널 + 브라우저 + IDE를 단일 인터페이스에서

아직 일부 기능이 실험적이지만, 멀티에이전트 작업에서 Computer Use가 어떤 역할을 하는지 보여주는 방향 지시다.

8.7 방법론적 정직성: Altman의 경고를 진지하게 받아들이기

Sam Altman의 "가짜 봇 느낌" 발언 [News, 2025]은 단순한 경쟁사 비방이 아니다. 이것은 커뮤니티 sentiment를 소스로 쓸 때의 방법론적 주의다.

이 책이 Reddit / HN / Medium에서 인용하는 "커뮤니티 반응"은 선택적 표본이다. 조직적으로 증폭된 목소리가 섞여 있을 수 있다. 이 챕터의 레시피들은 "커뮤니티가 이렇게 말했다"가 아니라 독립적 실험([Ahmed, 2026])이나 여러 소스의 수렴([Osmani, 2026], [NGUYEN, 2026])에 기반한 것만 포함했다.

참고문헌

- Dev.to, "Claude Code Reddit 500+ comments synthesis," 2026. [contributor, 2026]

- Altman, Sam, "Fake bots on Reddit," X, 2025-09-08. [News, 2025]

- MorphLLM, "Codex vs Claude Code Benchmark," 2026. [MorphLLM, 2026]

- Mejba Ahmed, "I ran Codex inside Claude Code," 2026. [Ahmed, 2026]

- Osmani, Addy, "Code orchestra — multi-model routing," 2026. [Osmani, 2026]

- Luong, "Local LLMs with frontier models — 3-tier setup," 2026. [NGUYEN, 2026]

- Zack Proser, "Codex daily-use review," 2026. [Proser, 2026]

- GitHub, "Codex subagents issue #11354," 2026. [contributors, 2026]

- LetsDS, "Codex Desktop — 90+ plugins," 2026. [Science, 2026]

- Matthew Berman, "GPT-5.5 two-week prerelease review," 2026. [Berman, 2026]

- LLM Stats, "GPT-5.5 vs Opus 4.7," 2026. [Stats, 2026]

- Intuition, "Codex as superapp," 2026. [IntuitionLabs, 2026]

- MerchMind, "Claude Opus 4.7 Backlash Explained," 2026. [AI, 2026]

- Xlork, "Why Developers Are Frustrated with Opus 4.7," 2026. [Blog, 2026]