Chapter 2: 두 도구의 비교 — Claude Code와 Codex의 철학과 인터페이스

2.1 같은 문제, 두 가지 답

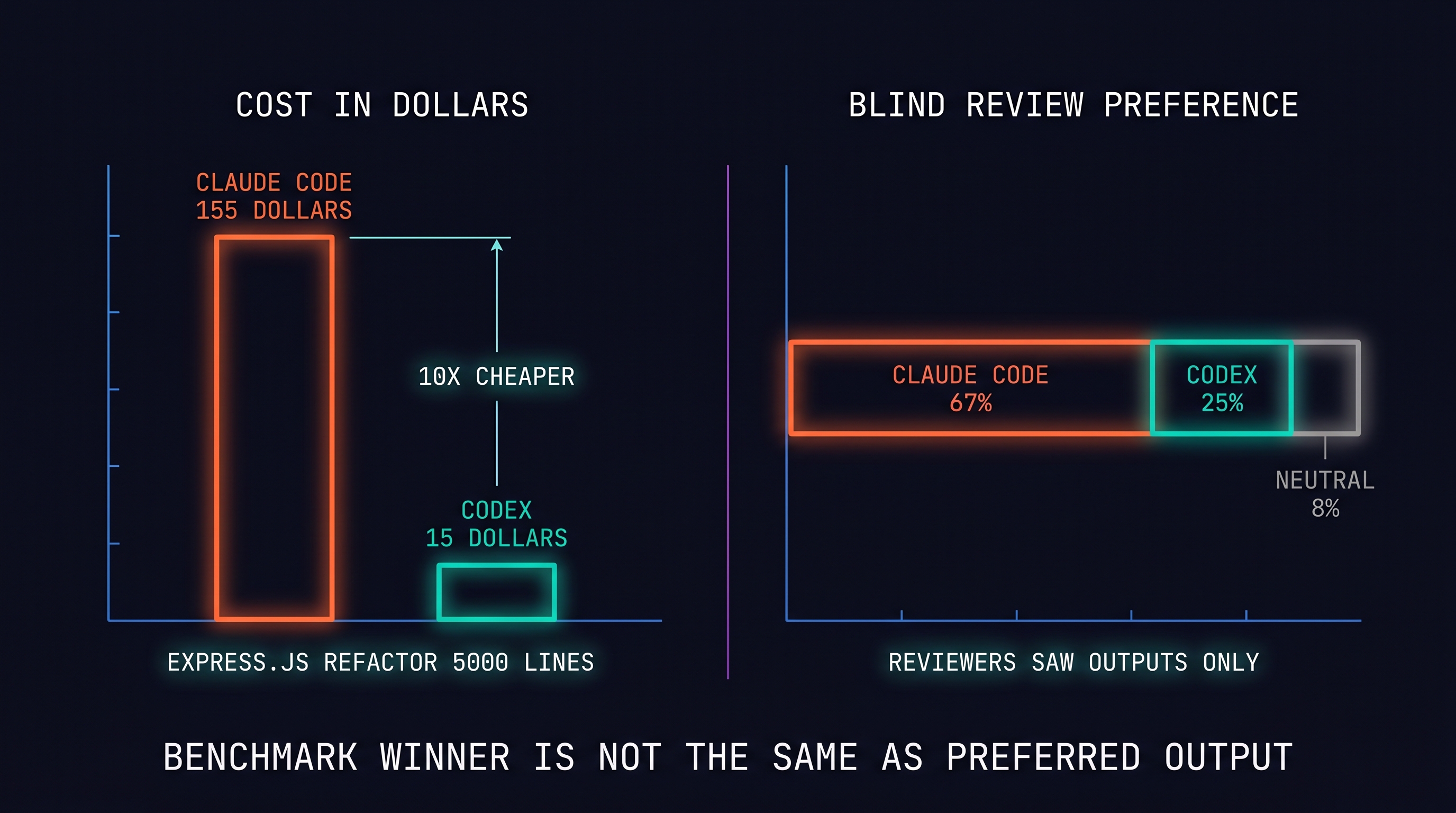

구체적인 사례부터 시작하자. 5000줄짜리 Express.js 서비스를 리팩터링하는 작업. 두 도구로 같은 작업을 실행하면 어떻게 다를까?

커뮤니티에서 자주 인용되는 두 수치 [contributor, 2026]:

- 비용: 동일 Express.js 리팩터링 작업에 Claude Code $155 vs Codex $15 — Codex가 10배 저렴 (token 사용량 차이에서 도출된 비용)

- 블라인드 품질 평가: 결과만 보고 선호도를 선택할 때 Claude Code 67% vs Codex 25% (동률 8%, 500+ 개발자 Reddit 설문)

즉, Claude Code는 더 비싸고 품질이 더 좋다. Codex는 더 싸고 품질이 약간 낮다. 하지만 이 수치는 7가지 차원 중 하나인 비용/품질 트레이드오프만 보여준다. 나머지 여섯 차원을 보면 이야기가 더 복잡해진다.

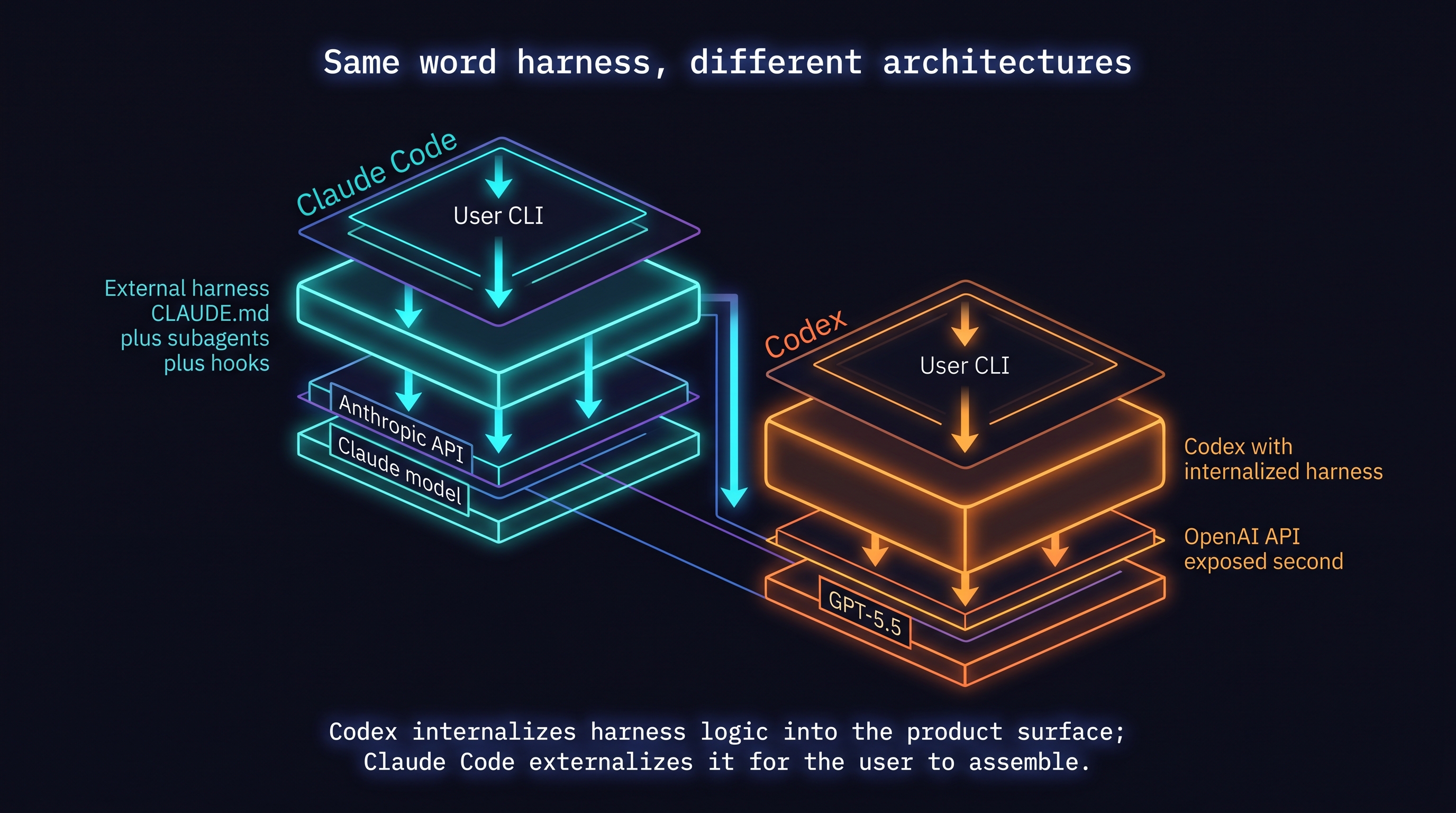

배달 채널 관점: Anthropic은 Claude Code를 API 위에 올린 외부 하네스 레이어로 설계했다 [Anthropic, 2026]. OpenAI는 GPT-5.5를 API보다 먼저 Codex에 탑재했다 [Willison, 2026]. 같은 단어("하네스")이지만 아키텍처가 다르다 — Codex는 하네스를 제품 표면에 내재화하고, Claude Code는 사용자가 외부에서 조립한다.

2.2 7가지 차원 비교

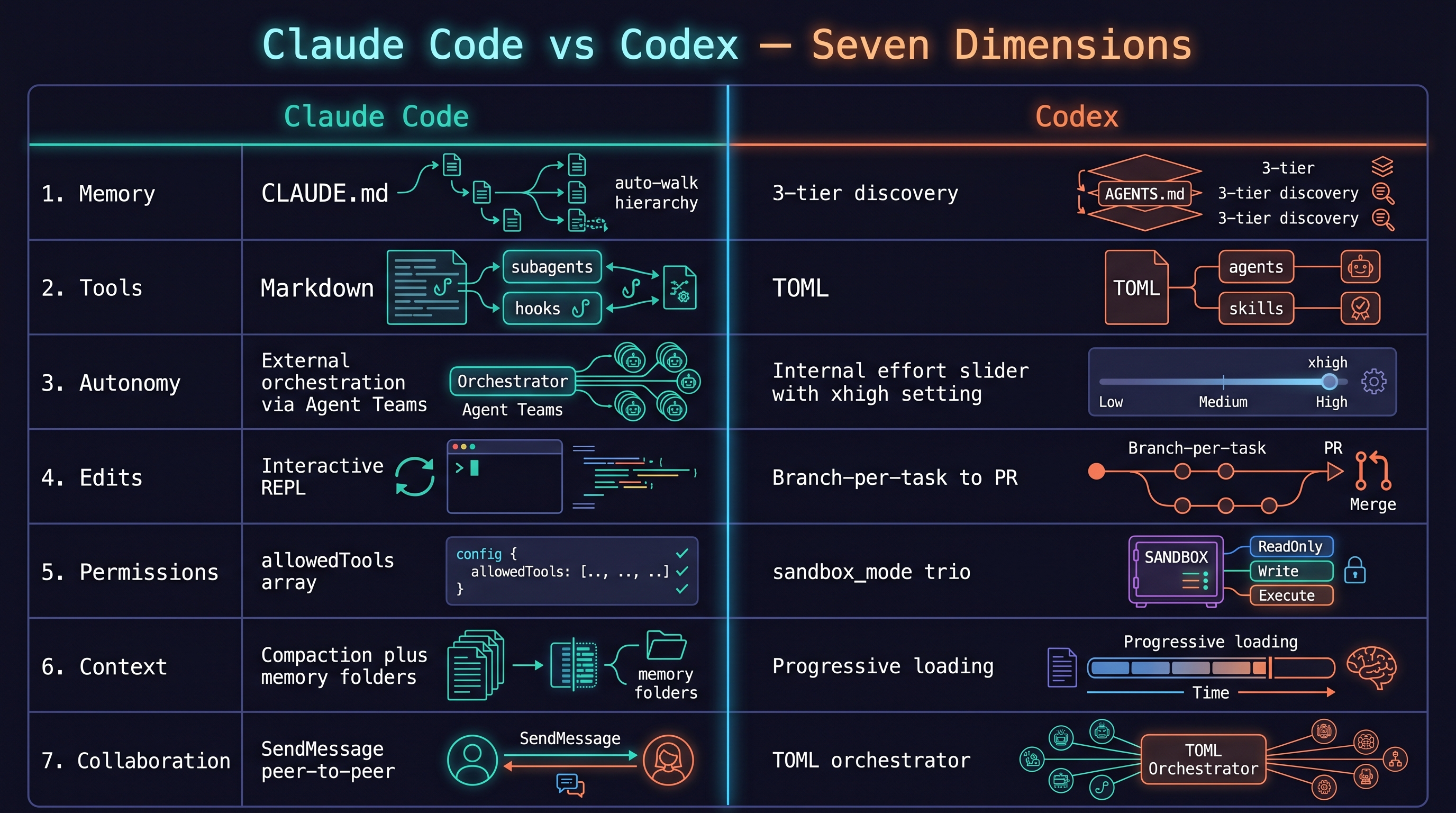

차원 1: 메모리 모델

Claude Code: CLAUDE.md 계층 구조 + 자동 워크. 루트 ~/.claude/CLAUDE.md(글로벌) → 프로젝트 루트 CLAUDE.md → 서브디렉토리 .claude/CLAUDE.md까지 자동으로 읽는다. .claude/memory/ 폴더를 통한 에이전트 주도 메모리 지속성 [Anthropic, 2026].

Codex: AGENTS.md 3-tier 발견 + override 우선순위. 현재 디렉토리에서 루트 방향으로 상위 AGENTS.md를 찾고, ~/.codex/ 글로벌 설정, .codex/agents/ 서브에이전트 정의 [OpenAI, 2026]. Override 우선순위: 더 구체적인 경로가 이긴다.

트레이드오프: Claude의 자동 워크는 편리하지만 어떤 규칙이 적용되는지 추적하기 어렵다. Codex의 명시적 3-tier는 더 예측 가능하지만 직접 파일을 찾아야 한다.

차원 2: 도구 모델

Claude Code: subagents를 함수처럼 호출. .claude/agents/에 마크다운으로 에이전트를 정의하고, 메인 에이전트가 invoke_subagent로 호출 [Anthropic, 2026]. hooks(.claude/hooks/)로 도구 실행 전후 로직을 삽입한다.

Codex: agents를 TOML 파일로 정의. .codex/agents/에 name, description, developer_instructions를 쓰면 Codex가 자동 발견 [OpenAI, 2026]. skills는 SKILL.md frontmatter로 정의 [OpenAI, 2026].

트레이드오프: Claude의 마크다운 에이전트는 인간 친화적이지만 스키마가 느슨하다. Codex의 TOML은 더 구조화되어 있고 도구 간 이식성이 높다 — AGENTS.md는 현재 60,000+ 오픈소스 프로젝트에서 채택한 표준이다 [Foundation, 2026].

차원 3: 자율성 모델

Claude Code: 하네스가 외부에서 자율성을 조율한다. Agent Teams [Anthropic, 2026]로 여러 에이전트가 공유 태스크 리스트를 통해 협력하고, SendMessage로 peer 에이전트에게 메시지를 보낸다. 자율성의 폭은 사용자가 하네스 설계로 결정한다.

Codex: 자율성이 reasoning effort로 내재화된다. config.toml에서 model_reasoning_model_reasoning_effort = "xhigh" 설정 한 줄이 모델의 추론 깊이를 조절한다 [OpenAI, 2026]. GPT-5.5에서 xhigh effort는 none의 약 240배 reasoning token을 사용한다 [Willison, 2026].

트레이드오프: Claude의 외부 자율성 조율은 세밀한 제어가 가능하지만 복잡하다. Codex의 effort 슬라이더는 단순하지만 내부에서 무슨 일이 벌어지는지 알기 어렵다.

차원 4: 수정 모델

Claude Code: 대화형 REPL. 매 터미널 세션이 상태를 유지하고, 변경이 즉시 파일시스템에 반영된다. /undo로 직전 변경을 되돌릴 수 있다.

Codex: task-per-branch. 각 태스크가 독립 브랜치에서 실행되며, 완료 후 PR로 올라온다 [Proser, 2026]. 여러 태스크가 병렬로 다른 브랜치에서 동시에 진행 가능하다.

트레이드오프: Claude의 REPL은 빠른 탐색에 좋다. Codex의 branch-per-task는 더 안전하고 병렬화가 쉽다 — 여러 태스크를 동시에 던져놓고 결과를 합칠 수 있다.

차원 5: 권한 모델

Claude Code: auto-mode + allowlists. 대화 중 도구 실행 시 사용자 확인 요청 또는 auto-approve 가능. .claude/settings.json의 allowedTools 배열로 세밀한 제어 [Anthropic, 2026].

Codex: sandbox_mode 트리오 [OpenAI, 2026]:

read-only: 파일 읽기만 허용 (가장 보수적)workspace-write: 현재 워크스페이스 쓰기 허용 (기본 권장)danger-full-access: 시스템 전체 접근 (주의)

approval_policy로 human-in-the-loop 게이트를 설정한다 (untrusted / on-request / never).

트레이드오프: Claude의 세밀한 도구별 제어 vs Codex의 sandbox 레벨 선택. Codex의 단순함이 운영 안전성에는 유리하다.

차원 6: 컨텍스트 관리

Claude Code: compaction + memory folders. 컨텍스트가 길어지면 Claude가 과거 내용을 요약(compaction)하여 컨텍스트 창을 재활용한다 — Opus 4.6에서 BrowseComp 84% 달성 [Martin and Anthropic, 2026]. memory folder 패턴으로 에이전트가 파일에 맥락을 쓰고 읽는다.

Codex: progressive context loading. AGENTS.md의 skill YAML frontmatter로 간략한 개요만 로드하고, 에이전트가 필요할 때 전체 내용을 읽는다 [OpenAI, 2026]. 브랜치 분리로 각 태스크의 컨텍스트도 분리된다.

트레이드오프: Claude의 compaction은 장기 세션에 강하다. Codex의 progressive loading은 초기 컨텍스트를 더 lean하게 유지한다.

차원 7: 협업 모델

Claude Code: Agent Teams + SendMessage [Anthropic, 2026]. TeamCreate로 에이전트 팀을 만들고, TaskCreate + addBlockedBy/addBlocks로 의존성 그래프를 선언한다. 에이전트끼리 SendMessage로 직접 소통한다.

Codex: TOML 서브에이전트 + skills [OpenAI, 2026]. .codex/agents/에 TOML 파일로 각 에이전트를 정의하고, 오케스트레이터가 이들을 호출한다.

트레이드오프: Claude의 Agent Teams는 동적이고 런타임 협업이 풍부하다. Codex의 TOML 에이전트는 정적이고 선언적이다 — 복잡한 런타임 메시지 패싱보다 단순한 도구 구성에 적합하다.

2.3 왜 모든 차원이 비대칭인가

위의 7가지 차원은 단순한 기능 목록이 아니다. 하나의 아키텍처 결정 — 하네스가 어디에 사는가 — 에서 파생된 결과들이다.

Anthropic은 Claude Code를 사용자가 직접 조립하는 하네스로 설계했다: CLAUDE.md, .claude/agents/, .claude/hooks/, .claude/skills/. API가 기반이고, 하네스는 그 위에 사용자가 얹는 레이어다 [Anthropic, 2026].

OpenAI는 GPT-5.5를 API보다 먼저 Codex 안에 탑재해서 출시했다 [Willison, 2026]. 모델과 하네스가 함께 도착했다. API는 부차적이었다. frontier 모델이 API보다 하네스 제품 안에 먼저 들어온 순간, 하네스는 모델을 감싸는 레이어가 아니라 1차 배달 채널 자체가 됐다.

이 하나의 결정이 위의 모든 차원으로 파급된다: 메모리는 외부(사용자 작성) vs. 내부(제품 내장), 협업은 런타임 동적 vs. TOML 선언적, 자율성은 사용자 오케스트레이션 vs. effort 다이얼, 권한은 도구별 세밀 제어 vs. sandbox 레벨. 이것들은 임의의 차이가 아니다 — 모두 하나의 질문으로 수렴한다: 하네스를 누가 소유하는가?

2.4 수치로 보는 비교

| 지표 | Claude Code | Codex | 출처 |

|---|---|---|---|

| Express.js 리팩터링 비용 | $155 | $15 | [contributor, 2026] |

| 블라인드 리뷰 선호도 | 67% | 25% (동률 8%) | [contributor, 2026] |

| Terminal-Bench | 65.4 | 77.3 | [MorphLLM, 2026] |

| SWE-bench Verified (Sonnet 4.6) | 79.6% | — | [Anthropic, 2026] |

| AGENTS.md 채택 프로젝트 | N/A | 60,000+ | [Foundation, 2026] |

이 수치들이 말하는 것: Terminal-Bench에서는 Codex가 이기고, 블라인드 리뷰에서는 Claude Code가 이긴다. 벤치마크 승자 ≠ 선호하는 출력이다 [MorphLLM, 2026]. DataCamp의 비교 분석도 같은 결론에 도달한다 [DataCamp, 2026]: "빠른 대화형 코딩엔 Claude, 자율 장기 태스크엔 Codex."

2.5 중국 시장에서 본 세 번째 시각

Blake Cros의 중국 AI 코딩 도구 시장 분석 [Crosley, 2026]은 두 도구를 "interface philosophy" 차원에서 구분한다: "Claude는 개발자에게 더 많은 제어를 주는 대신 더 많은 설정을 요구한다. Codex는 제어를 가져가는 대신 더 단순한 시작점을 제공한다." 글로벌 관점에서도 이 구분이 명확하다.

2.6 요약: 철학이 다른 두 인터페이스

7차원을 통해 본 결론:

- Claude Code: 하네스를 사용자가 외부에서 조립한다. 더 많은 제어, 더 많은 설정.

- Codex: 하네스가 제품 안에 내재화된다. 더 단순한 시작, 더 예측 가능한 자율성.

어느 쪽이 "더 좋다"는 답은 없다. 3장에서는 Codex로 첫걸음을 떼는 법을, 4장부터는 두 도구 모두에서 통하는 하네스 엔지니어링 패턴을 배운다. 이 7차원이 그 학습의 좌표가 된다.

참고문헌

- MorphLLM, "Codex vs Claude Code Benchmark," 2026. [MorphLLM, 2026]

- Anthropic, "Claude Code: Best practices for agentic coding," 2026. [Anthropic, 2026]

- Anthropic, "Claude memory documentation," 2026. [Anthropic, 2026]

- Anthropic, "Subagents," 2026. [Anthropic, 2026]

- Anthropic, "Agent Teams," 2026. [Anthropic, 2026]

- Anthropic, "Harnessing Claude's Intelligence," 2026. [Martin and Anthropic, 2026]

- OpenAI, "AGENTS.md specification," 2026. [OpenAI, 2026]

- OpenAI, "Codex config reference," 2026. [OpenAI, 2026]

- OpenAI, "Codex subagents," 2026. [OpenAI, 2026]

- OpenAI, "Codex skills," 2026. [OpenAI, 2026]

- Willison, Simon, "GPT-5.5," simonwillison.net, 2026-04-23. [Willison, 2026]

- AGENTS.md Open Standard, "60K+ projects adoption," 2026. [Foundation, 2026]

- Anthropic, "Introducing Claude Sonnet 4.6," 2026-02-17. [Anthropic, 2026]

- DataCamp, "Codex vs Claude Code," 2026. [DataCamp, 2026]

- Blake Cros, "China AI coding market analysis," 2026. [Crosley, 2026]

- Zack Proser, "Codex daily-use review," 2026. [Proser, 2026]

- dev.to, "Claude Code vs Codex 2026 — What 500+ Reddit Developers Really Think," 2026. [contributor, 2026]